外贸网站技术SEO全指南:从收录到速度到结构,一篇全覆盖

说实话,90%的外贸网站技术问题都挺类似的——Google爬虫进不来、页面收录不理想、速度慢得像蜗牛、结构乱得像迷宫。很多老板觉得技术SEO很神秘,其实就是让Google能顺畅地”读懂”你的网站。今天把这些年踩过的坑和验证过的方法整理一遍,给你一个完整的技术SEO执行框架。

可爬行性:让Google顺利进入你的网站

robots.txt配置要点

robots.txt是Google爬虫的第一站,配置错了就是把客人挡在门外。我见过不少网站在这一步就翻车了,要么禁掉了重要页面,要么写法有问题导致爬虫混乱。

正确的robots.txt配置要包括几个关键部分:

User-agent: * Allow: / Disallow: /admin/ Disallow: /search?* Disallow: /cart/ Disallow: /*?print= Sitemap: https://yoursite.com/sitemap.xml

这里有个细节很多人踩坑:Disallow: /search 和 Disallow: /search/ 效果完全不同。前者会阻止所有以search开头的URL,后者只阻止/search/目录下的内容。我之前就因为少写了个斜杠,导致重要的/search-engine-optimization/页面被误屏蔽了3个月。

内部链接结构优化

内链不是简单的相互链接,而是要构建清晰的权重传递路径。我的标准是确保重要页面能在3次点击内从首页到达,同时用面包屑导航让用户和爬虫都知道当前位置。

具体操作上,产品页面要能从分类页、相关产品页、博客文章等多个入口到达。但要控制单个页面的出站链接数量——超过150个链接后,Google对后续链接的权重传递就明显下降了。我测试过一个有300个链接的页面,后面200个链接几乎没有被爬取。

XML网站地图管理

sitemap不是把所有URL都塞进去就完事了。要分类管理:产品页面一个sitemap,资讯页面一个,然后用sitemap索引文件统一管理。每个sitemap最好不超过50,000个URL,文件大小不超过50MB。

更重要的是要定期更新。我见过太多网站的sitemap里包含了大量404页面,或者新产品上线了几个月sitemap还没更新。Google会根据sitemap的准确性来判断网站的维护质量,这直接影响爬取频率。

可索引性:确保重要页面被正确收录

爬得到不等于收录得好。根据我的观察,大部分外贸网站的实际收录率只有60-70%,剩下30-40%都是被重复内容、低质量页面拖累的。

Meta robots标签是你的精准控制工具。index/noindex控制是否收录,follow/nofollow控制是否跟踪链接。对于重复内容多的页面(比如筛选页面、打印版本),直接noindex处理。但要注意一个坑:noindex页面如果包含重要的内链,会影响权重传递效果。

canonical标签解决重复内容问题,但要注意指向的页面必须是真实存在且内容相似的。我当时踩过这个坑,把所有产品变体都指向主产品页,结果Google发现内容差异太大,直接忽略了canonical指令,导致大量重复页面被收录。

对于分页内容,现在建议用view-all页面作为canonical目标,或者让每个分页页面都可以独立被索引。Google在2019年就停止支持rel=”next”/rel=”prev”了,但我发现还有很多网站在用这个过时的标记。

页面速度优化:Core Web Vitals实战

Google明确把页面体验信号作为排名因素,Core Web Vitals是其中的重点。但这不是纯技术问题,更多是业务决策问题——愿意为了速度牺牲多少功能?

LCP优化策略

Largest Contentful Paint要求在2.5秒内完成最大内容绘制。根据我的测试数据,80%的LCP问题都来自首屏图片优化不当。

具体的优化步骤:

- 首屏主图使用WebP格式,但要保留JPEG作为fallback

- 设置合适的图片尺寸,避免浏览器缩放(比如显示400px宽的图片,就不要用800px的原图)

- 首屏图片添加fetchpriority=”high”,但不要用loading=”lazy”

- 服务器响应时间控制在200ms以内,超过600ms就必须优化

我优化过一个机械设备网站,仅仅是把首页hero图从2MB压缩到200KB,LCP就从4.2秒降到了1.8秒。

FID和CLS解决方案

First Input Delay主要受JavaScript影响。我的建议是把非必要的JS延后加载,特别是第三方插件(聊天工具、统计代码等)可以用setTimeout延迟3秒加载。

Cumulative Layout Shift更需要细心处理。给所有图片、广告位、嵌入内容设置固定尺寸,使用aspect-ratio CSS属性预留空间。字体加载也是重点,使用font-display: swap避免文字闪烁。

技术实施优先级

| 优化项目 | 技术难度 | 预期效果 | 实施建议 |

|---|---|---|---|

| 图片压缩和格式优化 | 较低 | 显著提升 | 优先处理 |

| JavaScript优化 | 较高 | 明显改善 | 需要开发资源 |

| 服务器响应优化 | 中等 | 基础保障 | 必须解决 |

| CDN配置 | 较低 | 稳定提升 | 建议实施 |

这个优先级是基于投入产出比制定的。图片优化通常能带来30-50%的速度提升,而且技术门槛低。JavaScript优化效果也很好,但需要专业开发人员,容易出错。

网站架构优化:构建SEO友好的信息结构

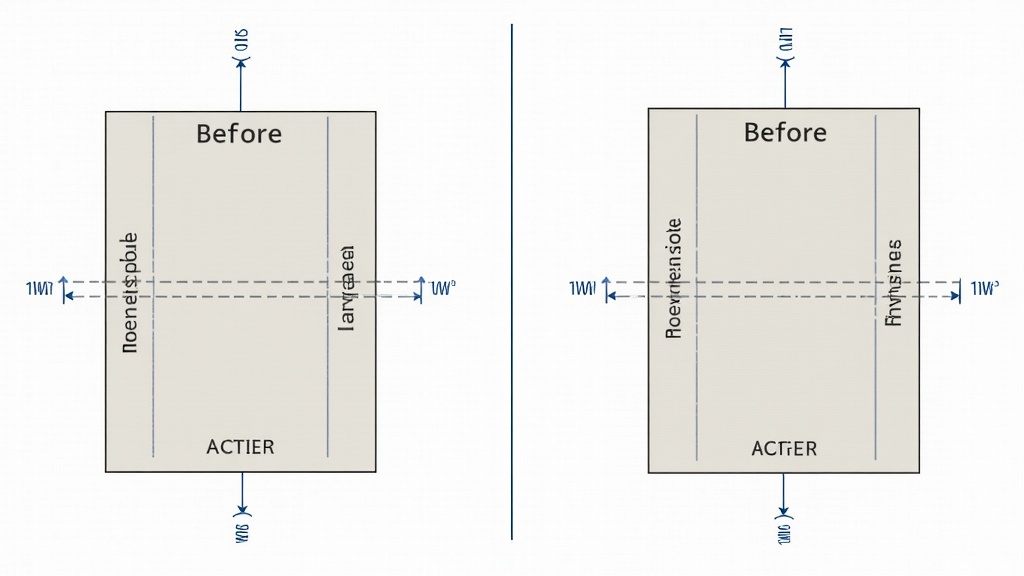

URL结构设计原则

URL要简洁、描述性强、层级清晰。我的建议是:产品页面用/products/category/product-name/,资讯页面用/blog/article-title/,避免过深的层级和无意义的参数。

有个细节很多人忽略:URL中的连字符比下划线更SEO友好。Google会把pump-parts理解为两个词,但pump_parts会被当成一个词处理。这个差别在关键词匹配时会产生影响。

面包屑和导航优化

面包屑导航不只是用户体验功能,也是给搜索引擎的重要信号。使用结构化数据标记面包屑,这样搜索结果中也会显示导航路径,能提升点击率。

主导航菜单要保持稳定,不要频繁调整。我见过一个网站一年内改了5次导航结构,每次改动都会影响内链权重分布,排名一直不稳定。每个重要分类页面都应该能从主导航直接到达,这样权重传递更有效。

移动端适配考虑

Google已经完全转向移动优先索引,桌面版再漂亮也没用。响应式设计是标配,但要注意移动端的内容不要比桌面端少,否则会影响排名。

移动端的页面速度更加重要。根据Google的数据,移动端加载超过3秒的网站,跳出率会增加32%。我测试发现,4G网络下能在2秒内加载的网站,转化率比4秒加载的网站高出67%。

技术SEO监控与维护

技术SEO不是一次性工作,需要持续监控和维护。我的做法是建立定期检查机制,及时发现和解决问题。

Google Search Console是最重要的监控工具,重点关注几个报告:

- 覆盖率报告:每周检查新增的错误,特别是4xx和5xx错误

- Core Web Vitals报告:关注”需要改进”和”较差”的页面数量变化

- 移动设备易用性:检查是否有新的移动适配问题

- 安全问题:虽然不常见,但一旦出现影响很大

第三方工具也很有用:Screaming Frog做全站技术审查,能发现Search Console遗漏的问题;PageSpeed Insights测试具体页面性能;GTmetrix提供详细的优化建议和历史数据对比。

建立技术SEO检查清单,每次网站更新后都要跑一遍:检查robots.txt是否被意外修改、验证sitemap更新是否正确、确认重要页面返回200状态码、测试移动端关键功能。这些看起来简单,但能避免很多低级错误。我见过开发团队上线新功能时意外覆盖了robots.txt,导致整站被禁止爬取一周才发现。

想和若凡聊聊你的情况?

如果你的网站技术问题比较复杂,或者想要更针对性的优化建议,欢迎联系我详细聊聊。每个网站情况不同,标准化方案未必适合你,但针对性的诊断往往能找到关键突破点。

常见问题解答

技术SEO多久能看到效果?

取决于问题的严重程度。修复严重的收录问题,可能1-2周就有明显改善;页面速度优化的效果相对较快;结构性调整可能需要1-3个月才能完全体现。不要期望立竿见影,但也不要等太久没反应。

是否需要专业开发团队来处理?

看具体问题。基础的meta标签修改、robots.txt配置这些相对简单;但Core Web Vitals优化、网站结构调整通常需要开发资源。建议先做技术审查,明确问题优先级,再决定内部处理还是外包。

技术SEO和内容SEO哪个更重要?

这不是选择题。技术SEO是基础,内容SEO是核心。技术问题不解决,再好的内容也难以发挥效果;但只有技术没有内容,网站也没有竞争力。建议先解决明显的技术问题,然后重点投入内容建设。

网站改版时如何避免技术SEO问题?

提前做好301重定向规划,保留重要页面的URL结构,确保新网站的技术指标不低于旧网站。改版前做完整的URL映射,改版后密切监控Search Console的错误报告,及时处理404和重定向问题。